ChatGPT är en avancerad maskininlärningsmodell utvecklad av OpenAI som utför naturlig språkförståelse och textgenerering. Den tränades på enorma mängder data från internet för att ge svar på frågor, slutföra text, skriva innehåll och skapa chatbot-svar.

Modellen använder en stor språkmodell, GPT-3, och förbättras kontinuerligt genom användarfeedback för att säkerställa noggrannhet och relevans i sina svar.

- Visa fullständig lista

Vad är ChatGPT?

ChatGPT (Chat Generative Pre-trained Transformer) är en serie populära generativa AI-chattbotar utvecklade och underhållna av OpenAI.

De stora språkmodellerna (LLMs) som stöder tidigare chattbotsmodeller var unimodala och kunde endast bearbeta och generera text. De senaste versionerna av chattboten är multimodala och kan känna igen bilder, generera bilder, delta i röstkonversationer och söka på internet i realtid genom samma konversationella användargränssnitt (CUI).

OpenAI tjänar pengar på ChatGPT genom att ta betalt av utvecklare för åtkomst till chattbotens applikationsprogrammeringsgränssnitt (API) och erbjuda två typer av betalda prenumerationer. För att ge utvecklare med olika kodningskompetenser möjlighet har OpenAI släppt ett dra-och-släpp-verktyg som heter Assistants API. Detta lågkod/ingen-kod (LCNC) utvecklingsverktyg gör det möjligt för slutanvändare med minimal kodningserfarenhet att skapa anpassade chattbotar som kan delas eller säljas via OpenAI:s GPT-butik.

ChatGPT har för närvarande över två miljoner utvecklare och över 100 miljoner aktiva användare varje vecka och används av minst 92% av Fortune 500-företagen. För att säkerställa att artificiell intelligens (AI) används ansvarsfullt övervakar AI-ingenjörer och automatiserade övervakningssystem kontinuerligt användarnas inmatningar och modellens resultat. För att skydda användardataintegritet använder OpenAI inte ChatGPT-konversationer för modellträning utan samtycke.

Hur fungerar ChatGPT?

ChatGPT bearbetar och genererar innehåll i små delar som kallas tokens. De ger en konsekvent metod för ChatGPT:s neuronätverksarkitektur att omvandla textsträngar med variabel längd till mer hanterbara, fasta inmatningsvektorer.

När ChatGPT får en ny prompt bryter den först ner prompten i en serie tokens. Den analyserar sedan token-serien för att identifiera mönster och relationer och jämför dem med de mönster och relationer som modellen observerat i träningsdata.

Denna arkitektur använder en teknik kallad self-attention för att identifiera långdistansberoenden i innehåll och väga vikten av olika tokens i en sekvens. Processen utförs parallellt för att producera olika viktade representationer.

Resultaten sammanfogas och linjärt transformeras för att generera ett token-utdata. AI-modellen strävar efter att producera en serie statistiskt liknande tokens – men inte samma – som de data som användes under träningen.

Bearbetning för denna typ av djupinlärning (DL) sker mycket snabbt, och korta svar som statistiskt liknar träningsdatans semantik (mening) och syntax (strukturer) kan slutföras på millisekunder.

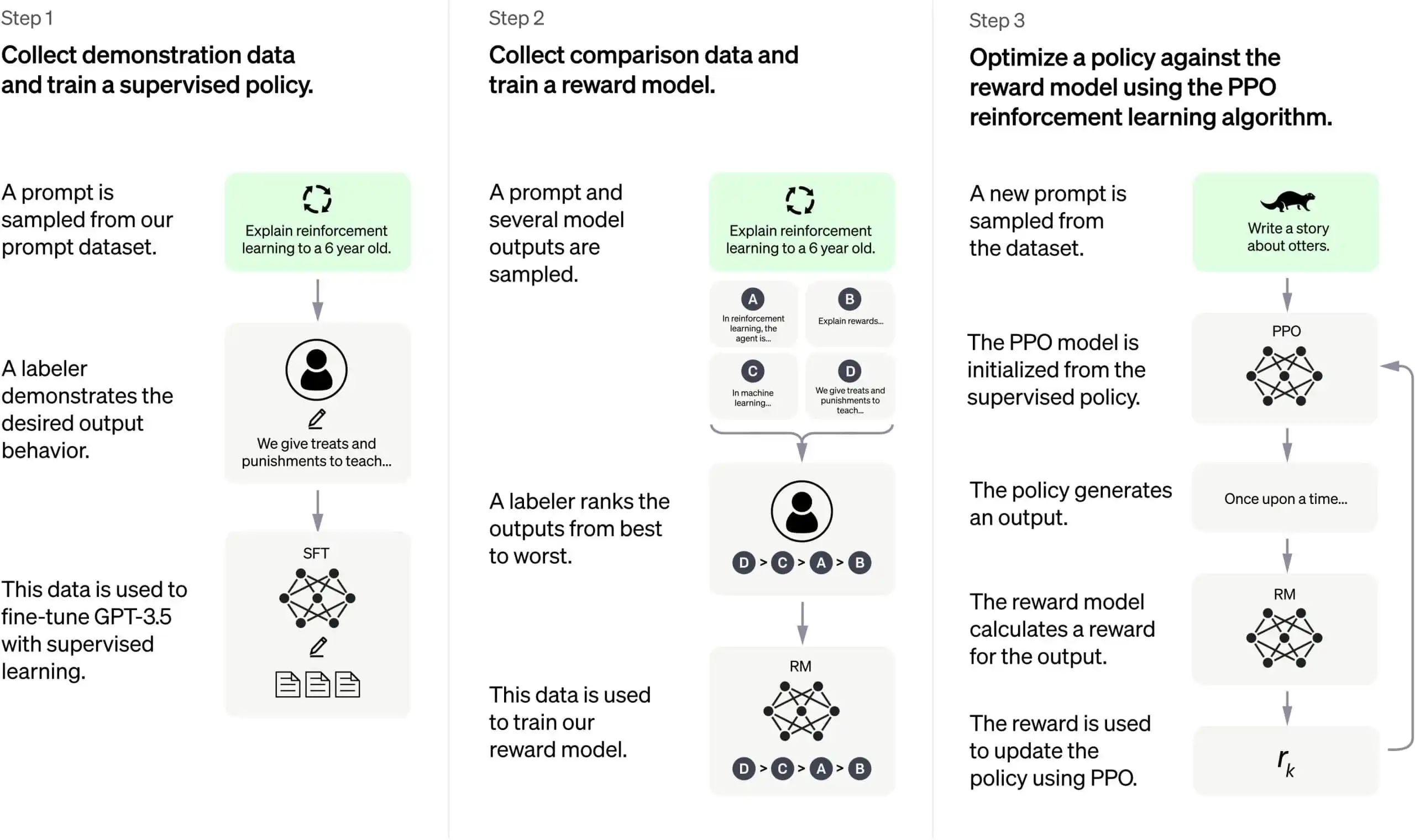

Hur tränades ChatGPT?

OpenAI använde ett webbcrawlingverktyg, GPTBot, för att samla in den stora mängd data som behövdes för att träna ChatGPT:s grundmodell, som tränades med “förstärkningsinlärning från mänsklig feedback” (RLHF). Detta är en relativt ny metod för att träna stora språkmodeller som kombinerar övervakad inlärning och strategier för förstärkningsinlärning.

I denna metod interagerade mänskliga tränare med en basversion av GPT-modellen för att generera konversationer där de spelade både användaren och en AI-assistent. (De mänskliga tränarna uppmuntrades också att utveckla sina egna interaktioner). Konversationerna blandades sedan in med den ursprungliga träningsdatan, och modellen använde den nya datamängden för att finjustera svaren.

Under denna del av träningsprocessen fick modellen uppgiften att generera flera potentiella svar på en given prompt, och de mänskliga tränarna rankade svaren baserat på deras kvalitet och relevans.

Modellen använder den rankade jämförelsedatan och en Proximal Policy Optimization (PPO) förstärkningsalgoritm för att lära sig vad som gjorde att vissa svar rankades högre än andra – och varför de högre rankade svaren bör användas i framtida interaktioner.

PPO fungerar genom att träna två policyer: en aktuell policy och en målpolicy. Den aktuella policyn används för att generera svar, och målpolicyn används för att utvärdera den aktuella policyn. Algoritmens uppgift är att uppdatera den aktuella policyn för att göra den mer lik målpolicyn.

PPO är en relativt enkel algoritm att implementera, och den är ett mycket effektivt verktyg för att inkorporera användarfeedback för kontinuerlig träning och hjälpa beslutsfattande enheter att optimera utdata i komplexa AI-miljöer.

Vem skapade ChatGPT?

ChatGPT skapades av OpenAI, ett forskningslaboratorium för artificiell intelligens bestående av den vinstdrivande OpenAI LP och dess icke-vinstdrivande moderbolag, OpenAI Inc.

OpenAI:s uppdrag är att säkerställa att artificiell generell intelligens gynnar hela mänskligheten. Teamet på OpenAI består av en mångsidig grupp AI-forskare, ingenjörer och andra yrkesverksamma som samarbetar för att utveckla stora språkmodeller för generativ AI.

Greg Brockman är ordförande och Ilya Sutskever är chefsforskare på OpenAI. Sam Altman är för närvarande VD.

Elon Musk var en av OpenAI:s medgrundare, men han avgick från styrelsen 2018 och utvecklar nu en alternativ chattbot kallad Grok för sin senaste startup, x.AI.

Är ChatGPT gratis?

Webbläsarversionen av GPT-3.5 är för närvarande gratis att använda, likaså OpenAI:s mobilappar för Android- och iOS-enheter.

Inte alla ChatGPT-erbjudanden är gratis.

- Frekventa användare som vill ha snabbare svarstider och pålitlig tillgång under rusningstid kan prenumerera på ChatGPT Plus. ChatGPT Plus är en prenumerationsmodell som kostar 20 $/månad och erbjuder garanterad tillgång till ChatGPT under rusningstid, snabbare svarstider och prioriterad tillgång till nya funktioner och förbättringar.

- ChatGPT Enterprise är en betald prenumerationsmodell för företag. Denna version kan ansluta till internet och används ofta för att förbättra kundengagemang och tjänsteleverans. ChatGPT Enterprise kostar 300 $/månad och erbjuder alla fördelarna med ChatGPT Plus, samt dedikerad teknisk support och tillgång till prompt engineering-mallar speciellt utformade för företagsanvändare.

- OpenAI erbjuder också en betalningsmodell per användning för ChatGPT API. API:et är ett gränssnitt som gör det möjligt för utvecklare att skicka inmatningar och ta emot svar från ChatGPT-modellen programmässigt. API:et gör det möjligt för utvecklare att integrera ChatGPT:s konversationskapacitet i sina egna applikationer eller tjänster. Användningskostnaderna bestäms av antalet API-anrop. API:et för GPT-4 Turbo är för närvarande den billigaste modellen för utvecklare att använda.

Hur man får tillgång till ChatGPT

ChatGPT kan användas gratis via webbläsare, webbläsartillägg, mobilappar och API:er i vissa tredjepartsapplikationer.

Webbläsarversionen av ChatGPT ger användare tillgång till deras chattlogg och kontoinställningar. Mobilversionerna erbjuder röstchatt, realtidssökning på internet och bildigenkänningsfunktioner.

Webbläsare

Gå till chat.openai.com och registrera ett konto. När du är inloggad, skriv in en prompt och klicka på den grå “skicka meddelande”-pilen i promptfältet. ChatGPT:s svar kommer att ha en valfri “generera igen”-knapp samt tumme upp/tumme ner-ikoner. Användarfeedback hjälper till att förbättra framtida svar.

Mobilappar

Besök Google Play Store eller Apple App Store för att ladda ner och installera de officiella OpenAI-mobilapparna för ChatGPT. Förutom sitt konversationella användargränssnitt (CUI) erbjuder de officiella mobilapparna samma funktioner som den senaste webbläsarversionen.

Plugin-program

För att installera ett ChatGPT-plugin för webbläsare, besök Chrome Web Store eller Firefox Add-ons store och sök efter “ChatGPT.” När webbläsarpluginet har installerats kan användare klicka på ChatGPT-ikonen i webbläsarens verktygsfält och skriva en prompt från vilken webbsida som helst.

GPT Plus

ChatGPT Plus är en betald prenumerationsplan för individer som vill ha garanterad tillgång till ChatGPT-3.5 och ChatGPT-4. Detta alternativ kostar 20 $ per månad och är ett bra val för användare som behöver pålitlig tillgång till ChatGPT under högtrafik. Det är också ett bra alternativ för användare som vill vara bland de första att prova nya funktioner och förbättringar eftersom OpenAI använder denna version av chattboten för canary-releaser.

ChatGPT Enterprise

Denna betalda prenumerationsmodell är utformad för att tillhandahålla en rad avancerade funktioner för företag, inklusive mer robusta säkerhets- och riskhanteringsfunktioner. Funktioner inkluderar:

- API-integration.

- Single sign-on (SSO) och domänverifiering för AI.

- Anpassningsbara mallar som hjälper till att säkerställa att alla anställda använder ChatGPT på ett säkert, enhetligt och varumärkesanpassat sätt.

- Avancerade dataanalyssfunktioner och verkställande dashboards som kan hjälpa företag att identifiera trender och generera innehåll för rapporter.

GPT API

OpenAI tillhandahåller detaljerad dokumentation för utvecklargemenskapen som beskriver hur utvecklare kan använda Chat GPT:s API för att göra förfrågningar, hantera svar, hantera parametrar och justera temperaturen (en hyperparameter som styr slumpmässigheten i modellens utdata).

Offlineåtkomst

Det finns ett antal offentligt tillgängliga skript som gör det möjligt att använda ChatGPT offline. De kräver vanligtvis att användare laddar ner ChatGPT-modellen till sin dator och kör den stora språkmodellen lokalt.

Vad kan ChatGPT göra?

ChatGPT-modeller utvecklas fortfarande, men de har redan visat sin potential att vara förändringsagenter för människor som använder internet, gör sina jobb och slutför uppgifter som kräver kreativitet.

För närvarande kan ChatGPT användas för att:

- Svara på frågor

- Slutföra en given text eller fras

- Skapa dispositioner för fiktion och facklitteratur

- Generera kort fiktion och facklitteratur från prompts

- Svara på användarinmatningar i olika samtalstoner

- Analysera sentiment

- Översätta textprover från ett språk till ett annat

- Utföra beräkningar

- Generera programmeringskod och rätta buggar i befintlig kod

- Sammanfatta en given text

- Faktagranska ett textprov

- Erbjuda förslag för hur ett textprov kan göras mer korrekt, tydligt och koncist

- Klassificera informationen i en given text i olika kategorier

- Organisera text i en tabell

- Erbjuda förslag på hur man kan använda, analysera eller sammanfatta data i ett kalkylblad

- Erbjuda HTML för en tabell eller jämförelsediagram

- Generera HTML för knappar, kryssrutor och inmatningsformulär på en webbsida

- Erbjuda ämnesspecifika och långsvansade nyckelord för sökmotoroptimering (SEO)

- Använda röst för att föra en konversation

- Söka på internet

- Diskutera en bild

Hur använder människor ChatGPT?

ChatGPT och liknande generativa modeller används alltmer inom nya områden och affärssammanhang.

Nedan följer några av de sätt som individer och företag för närvarande använder ChatGPT.

När släpptes ChatGPT?

Den ursprungliga modellen i GPT-serien introducerades i juni 2018. Varje ny version har förbättrats i fråga om kapacitet, prestanda, säkerhet, användarens integritet och skalbarhet.

- GPT-2: GPT-2 tillkännagavs i februari 2019 av OpenAI. Till en början släppte OpenAI inte hela modellen på grund av oro för dess potentiella missbruk. Efter att ha implementerat säkerhetsåtgärder släppte OpenAI den fullt tränade GPT-2-modellen i november 2019.

- GPT-3: GPT-3 introducerades i juni 2020. OpenAI introducerade ett nytt tillvägagångssätt för att komma åt GPT-3. Istället för att släppa den tränade modellen offentligt, tillhandahöll OpenAI tillgång till GPT-3 genom ett applikationsprogrammeringsgränssnitt (API). Detta gjorde att OpenAI kunde behålla kontrollen över teknikens användning.

- GPT-3.5: GPT-3.5 släpptes den 30 november 2022 och förbättrades avsevärt jämfört med tidigare versioner av ChatGPT. Den erbjöd flera nya funktioner och möjligheter, inklusive förmågan att generera mer realistiska och engagerande konversationer, förstå och svara på mer komplexa prompts samt efterlikna olika typer av skrivstilar och format.

- GPT-4: GPT-4 släpptes den 14 mars 2023. Den presterar snabbare och genererar mer exakta och omfattande svar på komplexa prompts. Denna version av chatboten erbjuder flera nya funktioner, inklusive möjligheten att söka på internet i realtid, acceptera bildprompts och använda röst för att föra konversationer.

- GPT-4 Turbo: GPT-4 Turbo är endast tillgänglig för utvecklare. Denna version av chatboten kan bearbeta motsvarande över 300 sidor text i en enda prompt och har en utökad kunskapsbas som inkluderar information fram till april 2023.

Skillnader mellan ChatGPT-3 och ChatGPT-4

ChatGPT-4 är efterföljaren till ChatGPT-3.5. Här är några av de viktigaste skillnaderna mellan de två versionerna av chatboten:

- Storlek: ChatGPT-4:s grundmodell är mycket större än de modeller som användes för att träna ChatGPT-3 och ChatGPT-3.5. Detta gör det möjligt för ChatGPT-4 att bearbeta fler typer av information och generera längre, mer komplexa svar.

- Multimodala förmågor: ChatGPT-3 och ChatGPT-3.5 kan bara bearbeta och generera text. Däremot kan ChatGPT-4 förstå, bearbeta och generera text, bilder och röst. (Redaktörens anmärkning: Chatbotens nyaste förmågor distribueras för närvarande genom canary-tester, så de kan vara otillgängliga för alla användare på alla enheter.)

- Noggrannhet och flyt: ChatGPT-4 är sannolikt mindre benägen att generera faktamässigt felaktiga svar eftersom den tränades på en mycket större och mer varierad dataset än tidigare versioner av ChatGPT.

Jämför ChatGPT-3 och ChatGPT-4

| Funktion/aspekt | ChatGPT-3 | ChatGPT-4 |

|---|---|---|

| Modellstorlek: | Ungefär 175 miljarder parametrar | Större (exakt storlek inte specificerad, men GPT-4 är mer avancerad) |

| Internetanslutning: | Nej | Ja |

| Kapacitet: | Avancerad textgenerering | Mer förfinad textgenerering, bättre förståelse av sammanhang |

| Svarsnoggrannhet: | Hög noggrannhet, med vissa misstag | Förbättrad noggrannhet och minskade bias, dock inte felfri |

| Anpassningsbarhet: | Begränsad | Förbättrade möjligheter för finjustering och användardefinierat beteende |

| Effektivitet: | Effektiv för sin tid | Generellt mer effektiv, drar nytta av nyare teknik och optimeringsmetoder |

| Bildinmatningsförmåga: | Ingen | Aktiverad, möjliggör bildbaserade frågor och interaktioner. Tendens att generera trovärdiga men felaktiga svar för bilder |

| Säkerhet och moderation: | Vissa förbättringar jämfört med tidigare modeller | Ytterligare förbättringar för att minska skadliga och osanna resultat |

| API-tillgänglighet: | Tillgänglig genom OpenAI API | Lika tillgänglig, med ytterligare funktioner och egenskaper |

| Vanliga användningsområden: | Chatbots, innehållsgenerering, handledning | Samma som GPT-3 men utökat för att inkludera uppgifter som involverar bildinmatning |

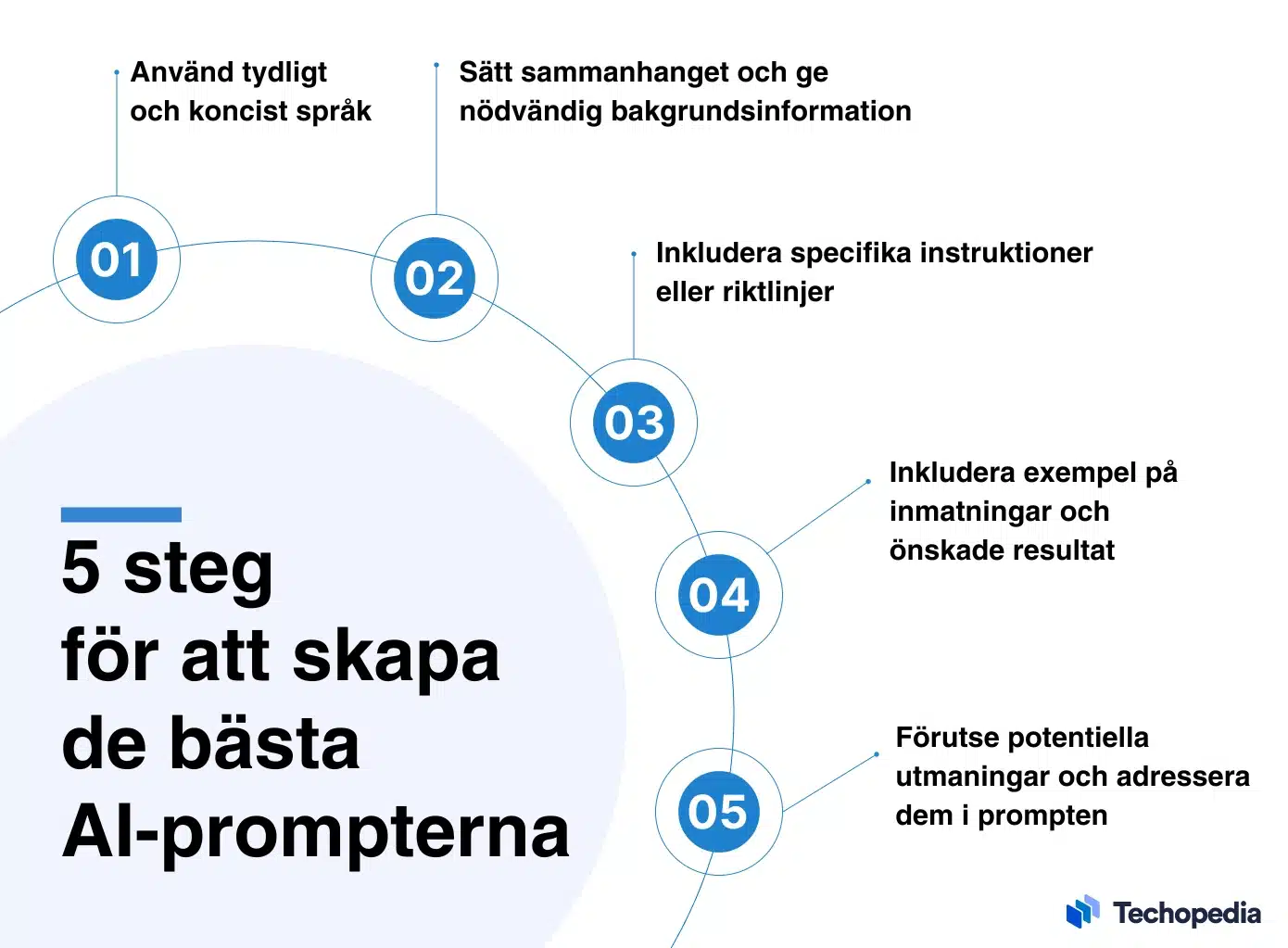

Hur man skriver ChatGPT-prompter

ChatGPT-användarinmatningar kallas prompter. De är startpunkten för varje konversation eller fråga och ger den stora språkmodellen som stöder GPT instruktioner och kontext för att återge svar.

För att skriva effektiva ChatGPT-prompter är det viktigt att vara tydlig, koncis och specifik.

Varje prompt bör ge tillräckligt med sammanhang och information för att den språkliga AI-modellen ska kunna generera ett omfattande och informativt svar. (Redaktörens anmärkning: Beroende på implementeringen kan ChatGPT minnas tidigare interaktioner inom samma session för att upprätthålla en sammanhängande konversation.)

Här är några tips för att skriva effektiva ChatGPT-prompter:

- Använd hela meningar och korrekt grammatik. Detta hjälper ChatGPT att förstå prompterna bättre och ge mer exakta svar.

- Dela upp långa prompter i en serie kortare och enklare prompter.

- Ordna prompterna i en logisk följd för att upprätthålla sammanhang.

- Ge chatboten det önskade formatet för varje svar.

- När ett promptsvar inte är acceptabelt, försök att återskapa svaret. Om det inte fungerar, ändra prompten stegvis för att successivt närma dig det önskade resultatet.

Hur man använder ChatGPT-svar

Användare måste inse att ChatGPT-svar inte baseras på faktisk kunskap. Svaren är enbart baserade på mönster och relationer som AI-modellen lärde sig under träningen.

Här är några tips för att använda ChatGPT-svar på ett etiskt och ansvarsfullt sätt:

- Använd inte svaren ordagrant. Även om ChatGPT kan producera sammanhängande och kontextuellt relevanta svar, är de inte alltid opartiska eller faktamässigt korrekta.

- Sök efter sätt att kombinera svar från en serie prompter på ett logiskt och sammanhängande sätt.

- Redigera de kombinerade svaren.

- Dubbelkolla att de kombinerade svaren är meningsfulla och faktamässigt korrekta.

- Följ relevanta riktlinjer för att citera ChatGPT som en referenskälla om det är tillämpligt.

Hur man tar bort den grå bakgrunden i ChatGPT-svar

När användare kopierar ChatGPT-svar med tangentbordsgenvägar behåller kopian formatet, inklusive grå bakgrund från gränssnittet.

För att ta bort den grå bakgrunden måste användarna använda kopieringsikonen högst upp i varje svar eller klistra in innehållet som oformaterad text. Här är några allmänna instruktioner för hur du klistrar in svar som oformaterad text:

Windows:

- Kopiera texten som vanligt med Ctrl + C;

- Använd Ctrl + Shift + V när du klistrar in;

- Alternativt, högerklicka, välj “Klistra in alternativ” och klicka på “Behåll endast text” för att ta bort formateringen.

Mac:

- Kopiera texten som vanligt med Kommando + C;

- Använd Shift + Option + Kommando + V när du klistrar in;

- Alternativt, leta efter “Klistra in och matcha stil” eller en liknande funktion i Redigera-menyn.

Webbläsare och ordbehandlare:

- Kopiera som vanligt.

- Högerklicka för att öppna snabbmenyn och leta efter alternativet “Klistra in som oformaterad text,” “Klistra in special,” “Behåll endast text” eller “Klistra in utan formatering.”

Om inga av dessa alternativ är tillgängliga, klistra in den kopierade texten i en enkel textredigerare som inte stöder formatering, till exempel Notepad eller TextEdit. Genom att kopiera den inlimmade versionen från textredigeraren bör all formatering tas bort – inklusive ChatGPT:s grå bakgrund.

Är det etiskt att använda ChatGPT?

Att använda ChatGPT är etiskt, men utvecklare, individer och företag som använder OpenAI:s modeller bör vara medvetna om flera överväganden som har väckt frågor om OpenAI:s etik.

- Enligt OpenAI samlade datavetare in den enorma mängd data som krävdes för att träna LLM genom web scraping. De kompletterade denna data med textkällor som antingen är i public domain eller offentligt tillgängliga. Även om detta sätt att samla in data för att träna ChatGPT var lagligt, känner många innehållsskapare att OpenAI borde ha samlat in träningsdata på ett etiskt sätt. Ett växande antal webbpublicister vill bli kompenserade för användningen av deras data.

- Ett relaterat bekymmer är att även om OpenAI inte avslöjade hur de kunde märka den stora mängden träningsdata för ChatGPT:s grundmodell, medgav de att de outsourcade en stor del av märkningen. Processen utnyttjade troligen crowdsourcing-plattformar som Amazons Mechanical Turk. Dess användning är kontroversiell eftersom MTurk-arbetare är korttidsentreprenörer som inte har hälsovårdsförmåner, ofta får betalt småsummor och inte har någon möjlighet till upprättelse om de inte får betalt för sitt arbete.

- Det kanske största bekymret är chattbotens förmåga att generera skadligt eller vilseledande innehåll som bryter mot OpenAI:s etiska skyddsåtgärder. Att hantera dessa bekymmer kräver skapandet av genomtänkta regerings- och företagspolicyer, nya riktlinjer för ansvarsfull AI och bästa praxis för att mildra de negativa effekterna av AI jailbreaking.

Är det säkert att använda ChatGPT?

Oro kring företagsdataläckage och integritet har lett till att OpenAI har infört policyer för att skydda data som delas i användarprompter. Det är dock viktigt att komma ihåg att säkerheten slutligen beror på i vilket sammanhang ChatGPT används.

Att använda modellen för utbildningsändamål, innehållsskapande eller informationsinsamling medan man följer riktlinjer anses generellt vara säkert. Däremot kan det vara extremt osäkert att använda modellen för att fatta viktiga beslut utan verifiering.

Till exempel är det viktigt att konsultera en kvalificerad professionell eller en trovärdig källa när du använder AI-assistenten för att få information om hälsa, ekonomi eller juridik. ChatGPT:s svar kanske inte är korrekta, uppdaterade eller verklighetsbaserade. Användare bör vara medvetna om teknikens begränsningar och använda sitt kritiska tänkande innan de använder svaren ordagrant.

ChatGPT och plagiat

När man använder innehåll som genererats av ChatGPT ordagrant är det viktigt att citera chatboten och ge korrekt källhänvisning för att undvika risken för plagiat.

Det beror på att när ChatGPT genererar svar kan det skapa resultat som liknar innehållet som modellen tränades på, vilket gör att innehållet kan flaggas av Turnitin eller liknande plagiatverktyg.

För att mildra denna oro kan användare köra det genererade innehållet genom AI-skrivarverktyg, inklusive plagiatdetekteringsverktyg, för att säkerställa innehållets originalitet och hjälpa användaren att göra nödvändiga justeringar.

Hur man citerar ChatGPT

Eftersom ChatGPT inte är en traditionell publikation eller en mänsklig författare blir det allt mer accepterat att behandla ChatGPT som en sökmotor och använda redigerade svar utan att tillskriva OpenAI.

När man citerar en källa som ChatGPT-4 i en forskningsartikel eller akademiskt sammanhang är det dock viktigt att ge ett erkännande som hänvisar läsaren tillbaka till informationskällan. Chatboten bör citeras som ett referensverktyg om den ursprungliga källan inte kan identifieras.

Här är ett förslag på hur du kan citera ChatGPT som ett referensverktyg:

ChatGPT [version], åtkomst [datum], https://www.openai.com/

Ersätter ChatGPT jobb?

Utvecklingen och användningen av ChatGPT och liknande AI-modeller förväntas påverka arbetsmarknaden på samma sätt som internet och andra teknologiska framsteg har gjort tidigare. Som med alla teknologiska framsteg kommer det troligen att ske en förändring i vilka färdigheter som efterfrågas.

20 jobs that Chat GPT 4 will replace in the near future . Predicted by the AI itself . pic.twitter.com/wleOgij9E5

— Prashanth Rangaswamy (@itisprashanth) March 16, 2023

Den utbredda användningen av ChatGPT kommer sannolikt att leda till förskjutning av jobb, jobbförstärkning och skapandet av nya yrkesroller. Men den bredare påverkan på vissa demografiska grupper på arbetsmarknaden beror på flera ekonomiska, samhälleliga och etiska val.

Policymakare, företagsledare och utbildare förväntas spela en viktig roll i att avgöra hur AI integreras i arbetskraften och hur potentiella jobbförluster hanteras. Det är redan tydligt att förberedelser för framtidens arbetsmarknad innebär kontinuerligt lärande (upskilling och reskilling) samt anpassningsförmåga.

Begränsningar med ChatGPT

Även om ChatGPT har många olika tillämpningar, är det viktigt att ta hänsyn till teknikens begränsningar. I grund och botten bör ChatGPT betraktas som ett förstärkt AI-verktyg och inte som en ensam sanningskälla (single source of truth, SSoT). Trots att chatboten verkar kunna klara olika versioner av Turing-testet, har den varken medvetande eller känslor.

Användare bör verifiera den information som tillhandahålls av ChatGPT med trovärdiga källor, särskilt inom kritiska områden som hälsa och ekonomi.

ChatGPT och AI-bias

Generativa modeller som ChatGPT lär sig från de data de tränas på. Om träningsdata innehåller fördomar kan modellerna lära sig och potentiellt förstärka befintliga stereotyper och ojämlikheter.

Bias i AI-modeller kan leda till diskriminerande praxis och kan potentiellt resultera i juridiska konsekvenser. Organisationer kan ställas inför stämningar och regulatoriska åtgärder om deras användning av ChatGPT resulterar i orättvis behandling eller diskriminering.

OpenAI är medveten om utmaningarna med inneboende bias i träningsdata och är engagerade i bästa praxis för att mildra den oavsiktliga påverkan av ChatGPT-modeller. Detta inkluderar:

- Användning av stora, mångsidiga dataset för träning för att fånga ett brett spektrum av mänsklig kunskap och minska specifika fördomar.

- Användning av mänskliga granskare under modellens finjusteringsfas och krav på att de följer riktlinjer som uttryckligen avråder från att gynna någon politisk grupp eller ta ställning i kontroversiella ämnen.

- Användning av en iterativ feedback-loop för att upprätthålla regelbunden kommunikation med mänskliga granskare och slutanvändare för att förfina modellens resultat och minimera fördomar.

- Prioritering av transparens och aktivt sökande av extern feedback om modellens beteende och distributionsstrategier.

Alternativ till ChatGPT

ChatGPT är kanske den mest populära stora språkmodellen för generativ AI, men det är inte den enda. Varje dag verkar det som om någon tillkännager ett alternativ till OpenAI:s LLM som kan uppfylla specifika behov och krav.

Noterbara alternativ till ChatGPT-4 inkluderar: